A Amazon Web Services (AWS) anunciou novas atualizações para o Guardrails for Amazon Bedrock, projetadas para aumentar a segurança e a confiabilidade de aplicações de IA generativa. Essas atualizações incluem a detecção de alucinações e uma API independente para fortalecer aplicações com guardrails personalizados em qualquer modelo, garantindo saídas responsáveis e confiáveis.

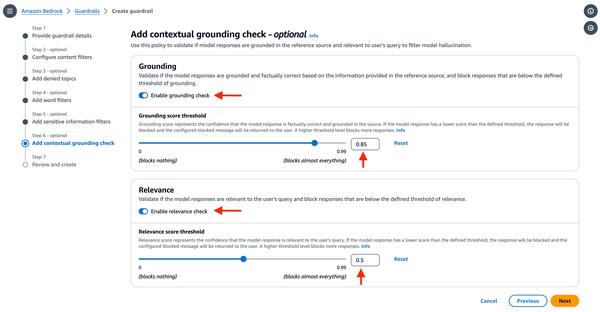

O recurso de detecção de alucinações é uma adição valiosa, pois permite que os clientes verifiquem a precisão das respostas do modelo com base em uma fonte de referência e na consulta do usuário. Isso ajuda a garantir que o modelo não esteja gerando informações incorretas ou novas que não sejam baseadas em dados factuais.

A API ApplyGuardrail permite que os clientes avaliem as entradas do usuário e as respostas do modelo em relação às medidas de segurança configuradas. Esse recurso é particularmente útil para organizações que usam LLMs autogerenciados ou de terceiros, pois permite que elas apliquem medidas de segurança padronizadas em todos os seus aplicativos.

Com essas atualizações, a AWS reafirma seu compromisso em fornecer ferramentas e soluções que permitem que os clientes criem aplicações de IA generativa seguras e confiáveis. O Guardrails for Amazon Bedrock é um passo significativo nessa direção, oferecendo aos clientes maior controle sobre o comportamento dos LLMs que eles utilizam.

Clientes interessados em saber mais sobre esses novos recursos podem visitar a página do produto Guardrails for Amazon Bedrock no site da AWS.